特斯拉自动驾驶出事故谁的错?日本专家用不同论调反驳媒体

牛车网网友骑驴找马 问:

特斯拉出事故导致人员死亡是“自动驾驶引发的事故”么?到底是什么原因比较有说服力?

牛车网网友今夜 答:

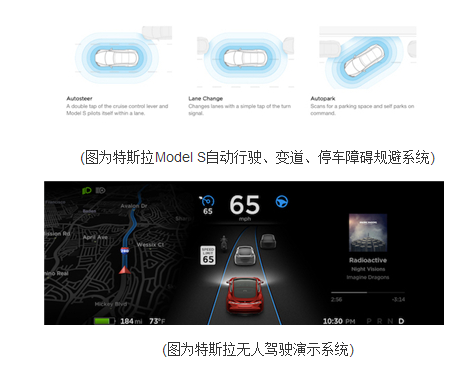

无人驾驶、自动驾驶这些功能虽然是智能汽车未来最优先攻克的课题,但是它们现在其实就和车道偏离预警,车道保持等等功能一样,只是个辅助驾驶的功能,并不能够做到真正意义上的“自动驾驶”。虽然谷歌和特斯拉的自动驾驶功能已经趋于相对完善,但是意外总还是有的,这只是个几率问题。

1.事件回顾

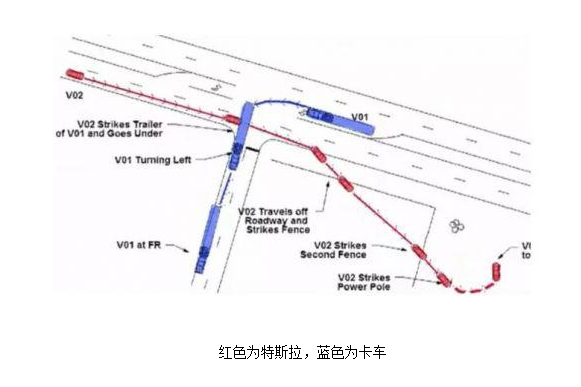

今年5月7日,国外一名科技公司的老板在使用特斯拉Model S汽车“自动驾驶(Autopilot)”功能时,因与拖挂车发生碰撞而死亡。事件发生在佛罗里达威利斯顿27号公路上,一辆使用自动驾驶模式的特斯拉2015版Model S电动汽车,在一个没有安装红绿灯的十字路口与一辆左转的大型牵挂型卡车相撞,导致车主当场死亡。特斯拉汽车全程没有减速刹车。 该自动驾驶系统采用的是传感器和摄像技术以探测道路前方的可能障碍物。然而,在这起事故中,这一系统却没有看到卡车在布朗的汽车前方左转,因此也就没有及时刹车,导致特斯拉直接钻到卡车底下,继续滑行直至撞破两道藩篱、滑行至高架南面才停住。

Joshua Brown为他的车起了一个昵称叫Tessy。他四月曾在You Tube上传他的tesla自动驾驶如何避免在变更车道时撞上其他车主的视频,这个视频还得到了特斯拉CEO伊隆·马斯克的转发。

2.特斯拉怎么回应的?

特斯拉公司的声明解释称因日照过于强烈,驾驶员与自动驾驶系统都未能注意到拖挂车的白色车身,从而导致启动刹车系统失败。特斯拉还强调在使用Autopilot的过程中,汽车会不断提示驾驶员要双手全程放在方向盘上,对车辆负责。与此同时,布朗发生车祸的高速路段也比较特殊。现场没有设置交通灯,而车辆被允许穿过车道进行往左的大转弯。这相当于兼具城市道路和高速路的危险特点。这种情况对于人类驾驶员来说也是一个挑战,对设计自动驾驶汽车的工程师更是如此。

3.事故不止特斯拉一家

早在2014年9月,加利福尼亚州就向共向48辆无人驾驶汽车授予了“上路通行证”。截至目前,在实地进行的无人驾驶测试中,有4辆发生了规模程度都较为轻微的事故,没有人员伤亡。其中,三起事故的主角为谷歌改装版的雷克萨斯SUV,而另一起则为向谷歌提供无人驾驶汽车必要传感器设备的德尔福自主测试车辆。此外,两起事故在发生时为完全无人驾驶模式,另外两起在发生时则有测试人员坐于车上。

雷克萨斯SUV因人工智能操作系统判断失误,撞上一辆巴士,当时其行驶时速仅为3.2公里,但没有人在这场意外中受伤,过程原因是谷歌无人驾驶汽车试图超过公交车,以躲过前方巷道中的沙袋。自上路测试以来,谷歌无人驾驶汽车发生的交通故事已有十几次,而这次的特殊之处在于,谷歌首次承认事故的责任方在其无人驾驶汽车。

总结:辅助驾驶技术还在发展之中,并不完美,需要驾驶者保持警惕。 科技的进步并不会因为失败而停止。宝马就在最近率先亮出了时间表,明确称将在2021年全面推行适合城市交通的自动驾驶汽车。此次任务将与芯片龙头企业英特尔及在计算机视觉与机器学习领域颇有分量的以色列科技公司Mobileye联手完成。经过这些无人驾驶技术的事故和失败是否就意味着我们不该再信任无人驾驶汽车?过于依赖电子设备可能也是我们自己的懒惰造成的。

牛车网网友车坛留几手 答:

之前手哥在日经技术上看到了一篇关于此事的采访,采访的是日本英特尔事业策划及政策推进总监、名古屋大学客座副教授野边继男。野边一直担忧这种事故会不会造成无人驾驶技术的停滞不前,尤其被媒体大肆错误报道后,人们会不会对无人驾驶技术感到不信任或者说是害怕。

1.野边对特斯拉事故的看法

野边:从美国警方发布的声明来看,事情是这样的。2016年5月7日下午3时40分许,Tesla Model S使用“Autopilot”功能在佛罗里达州莱维县(Levy County)的1条四车道高速公路上行驶。这时,1辆大型拖挂车越过两条车道,向Model S方向左转。Model S随即冲向前方几乎与其垂直的拖挂车,在从拖挂车下方钻出,撞击护栏两次后,撞上电线杆停了下来。驾驶员当场死亡。

对于这起事故,特斯拉汽车作出了如下解释。“在利用车载摄像头观察前方的情况下,拖挂车白色的侧面突然覆盖住了之前识别到的蓝天。摄像头未能识别出拖挂车,自动紧急制动没有启动”。对于这样的解释,我们需要进行分析,判断驾驶员在正常驾驶时如果遇到同样的情况,紧急制动系统能否启动以避免事故发生。

另一方面,在这次的案例中,驾驶员也有可能误会或是过于相信Autopilot的“自动驾驶”能力。在这一点上,特斯拉汽车和NHTSA可能会因为没有充分告知驾驶员和市场而受到指责。

干货

──通过哪些技术手段可以避免这样的事故?

野边:要想让紧急制动启动,除了配备不擅长瞬时曝光调整的摄像头之外,估计还需要结合使用79GHz毫米波雷达和光学雷达等,更准确地识别前方出现的物体,掌握并预测周围汽车和拖挂车的不规则运动。

另外还可以使用能够应对光线剧烈变化的摄像头。或是加入HDR(高动态范围)功能,通过拍摄常规曝光,以及曝光过多、曝光不足的图像,将这些图像进行合成,在不同的光线强弱条件下捕捉恒常图像。

──这起事故可能对今后的自动驾驶技术开发产生哪些影响?

野边:日本恐怕会出现抨击(批评)自动驾驶技术的论调。其实,现在的Autopilot并没有实现自动驾驶功能。截至目前,NHTSA还不允许市售汽车使用自动驾驶功能在公路上行驶,这次的事故并不是“自动行驶中发生的事故”。

实际上,自动驾驶的定义还比较模糊。NHTSA在2013年提出的“汽车自动化定义”方案中,将汽车自动化分成了“0~4级”。0级代表完全没有自动化。1级代表方向盘、油门和制动器这三个项目中,有1项以上独立实现了自动化。2级代表方向盘、油门和制动器中,有2项以上复合联动,实现了自动化。3级以上才是自动驾驶。

此次发生事故的Model S配备的当前版本的Autopilot,自动化水平属于NHTSA定义的2级以下,“最终责任由人负责”。NHTSA制定的“汽车自动化定义”在国际上得到了广泛认可,可以看作是自动化开发的方针。但是日本只翻译了该定义的一部分,而且有些解释还是错误的。这使得日本人与部分特斯拉用户都误以为目前的Autopilot实现了自动驾驶。似乎有媒体称本次事故的原因是“人工智能误判”等,离谱得令人无语。

在前面提到的方案中,NHTSA现在认可的自动驾驶仅仅是“公路测试”,并且作出了严格指示,以免在这一阶段发生事故,但方案也明确指出,没有事故的发生,技术就不会进步。因此,NHTSA要求企业在发生事故后,毫不隐瞒地上报详细情况。

NHTSA的最终目的还是要推进自动驾驶技术的开发。但愿日本对于此事的错误报道,不会阻碍日本的自动驾驶技术开发进程。

显示更多评论